朴素贝叶斯

一、定义

朴素贝叶斯 是基于贝叶斯定理与特征条件独立假设的分类方法。朴素贝叶斯是在贝叶斯算法的基础上进行了相应的简化,即假定给定目标值时属性之间相互条件独立,也就是说没有哪个属性变量对于决策结果来说占有着较大的比重,也没有哪个属性变量对于决策结果占有着较小的比重。虽然这个简化方式在一定程度上降低了贝叶斯分类算法的分类效果,但是在实际的应用场景中,极大地简化了贝叶斯方法的复杂性。

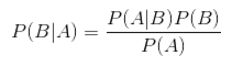

贝叶斯定理 解决了现实生活中已知条件概率,如何得到两个事件交换后的概率。例如:已知 P(A|B)的情况下,如何求出 P(B|A)的概率问题。贝叶斯定理的出现就是用来打通 P(A|B)到 P(B|A)之路,通用公式如下:

先验概率 :通过经验来判断事情发生的概率。

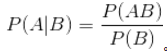

条件概率 :P(A|B) 表示事件 B 已经发生的前提下,事件 A 发生的概率,叫做事件 B 发生下事件 A 的条件概率。其基本求解公式为:

后验概率 :发生结果之后,推断原因的概率。它属于条件概率的一种 。

二、基本方法

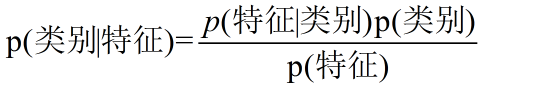

朴素贝叶斯法,对于给定的训练集,首先基于特征条件独立假设学习输入 / 输出的联合概率分布;然后基于此模型,对给定的输入 x,利用贝叶斯定理求出后验概率最大的输出 y。之所以朴素的思想基础是:对于给定的待分类项,求解在此项出现的特征条件下在各类别出现的概率,哪个最大,就认为此待分类项属于哪个类别。在分类算法里面应用,贝叶斯定理可以转换成下面的表达式

- 第一阶段:准备工作,确定训练样本集和特征属性。

- 第二阶段:分类器训练,计算先验概率和各类下各特征的条件概率。输入为样本集和特征属性,输出为分类器。

- 第三阶段:分类器应用,输入为分类器和待分类项,输出为待分类项的类。

三、总结:

- 朴素贝叶斯法是典型的生成学习方法。生成方法由训练数据学习联合概率分布 P(X,Y),然后求得后验概率分布 P(Y|X)。具体来说,利用训练数据学习 P(X|Y)和 P(Y)的估计,得到联合概率分布:P(X,Y)=P(Y)P(X|Y)。概率估计法可以是极大似然估计或者贝叶斯估计。

- 朴素贝叶斯法的基本假设是特征属性的条件独立性,在一个确定的类别上,特征属性条件独立,这是一个较强的假设,由于这一假设,模型包含的条件概率的数量大为减少,朴素贝叶斯的学习与预测大为简化,因而朴素贝叶斯法高效,且易于实现。缺点是分类的性能不一定很高。

- 朴素贝叶斯法利用贝叶斯定理与学到的联合概率模型进行分类预测。将输入的 x 分到后验概率最大的类 y。后验概率最大等价于 0 - 1 损失函数时的期望风险最小化。